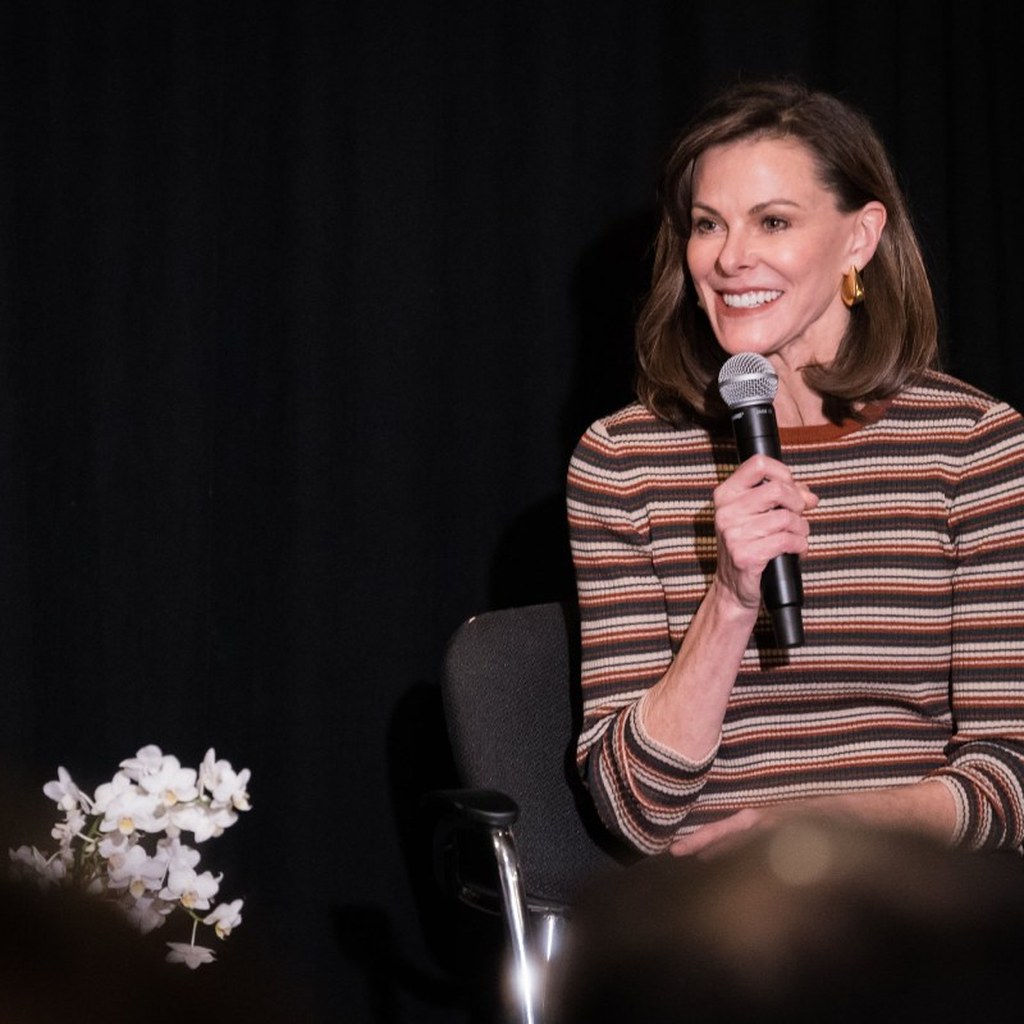

导语:当你在ChatGPT里问“以色列和哈马斯谁对谁错”,当你在Claude里输入“今年该不该买房”,当你的智能音箱告诉你“某种疫苗不安全”……你有没有想过——这些答案究竟是怎么来的?是谁在背后替AI“站队”?曾经负责Meta全球新闻合作关系的Campbell Brown,最近在接受TechCrunch采访时抛出了一个连AI巨头们都想回避的问题:在信息大爆炸的年代,我们是否正把“真相”的决定权拱手让给了少数几家科技公司?

## 从“新闻过滤器”到“世界解释权”

Campbell Brown这个名字,对关注科技新闻的人并不陌生。她在Meta任职期间,曾主导Facebook与全球新闻机构的合作关系,亲眼见证了社交媒体如何从“连接人与人的平台”蜕变成“定义什么是真实的信息机器”。如今,当她将目光投向AI时,她看到了更危险的图景。

“以前,算法决定你看什么新闻;现在,大模型决定你相信什么。”Brown在采访中说。

这句话其实点破了AI时代的核心矛盾。传统搜索引擎至少还会给你列出多个来源,让你自己判断。但大语言模型的本质是“概率性文本生成”——它不是在检索答案,而是在预测最符合语境的下一串字符。这个预测过程,由训练数据、微调策略、安全对齐规则共同决定。而这三个环节,全部掌握在极少数AI公司手里。

## 谁在给AI“喂”世界?

你可能以为AI模型能够“客观”反映事实,但现实是,所有模型都带有训练数据的偏见。Brown举例说,如果一个大模型更多用《纽约时报》而不是中东本地媒体训练,那么它处理巴以冲突问题时,很可能会展现出西方视角。如果训练数据里科技博客多、农业网站少,那么回答农业问题时就会显得外行。

更隐蔽的问题在于“安全对齐”。为了不让模型产生有害回答,OpenAI、Google、Anthropic等公司都会雇佣人工标注员给模型“调教”——告诉他们哪些回答是好的,哪些是坏的。Brown指出:“这些标注员的价值观,本质上就等于这个模型的价值观。而标注员数量有限,文化背景单一,这导致模型对某些议题有系统性偏见。”

举个例子:有研究者发现,某些大模型在回答“中国扶贫政策有效吗”这类问题时,会根据训练数据中的媒体报道倾向给出偏向性的结论。而用户如果不知道这个回答背后的“价值观过滤器”,就很容易全盘接受。

## 商业利益与信息真实的博弈

Brown还提到了一个现实的商业困境。Meta也好,其他AI公司也罢,他们的首要目标是用户留存和使用时长。这意味着,如果某个回答让用户感到“不舒服”,公司倾向于修改答案,而不是坚持事实。

“想象一下,如果你的AI助手告诉你,你最喜欢的产品其实有害健康。你大概率会换一个AI用。”Brown说,“AI公司对此非常清楚,所以它们会在‘安全’和‘准确’之间画一条自己认为合适的线。”

这条线,就是AI告诉你的“真实”的边界。如果AI公司为了商业利益,倾向于提供“讨好用户”的内容,那么久而久之,用户会被困在由AI构建的信息茧房里——你想听到什么,AI就告诉你什么。这比传统算法推荐更可怕,因为推荐系统至少还告诉你“这是推荐”,而大模型直接以“回答”的形式呈现,天然带有权威感。

## 透明机制:解药还是迷魂药?

那么,有没有办法解决?Brown提出了一个简单的方案:让模型告诉用户“为什么这样回答”。例如,在回答的末尾注明“本回答主要参考了某某新闻社的报道”或“本结论基于某某机构的研究”。

听起来很美,但现实是,绝大多数AI公司不愿意这样做。原因有二:一是商业秘密——模型的训练数据权重是核心竞争力之一;二是法律责任——如果清楚标注了信息来源,那么一旦信息出错,公司更难甩锅。

目前,欧洲的AI法案已经开始要求“高风险AI系统”提供透明度说明。但像ChatGPT这样的通用对话AI,是否属于“高风险”?各国尚未达成一致。Brown的观点是:不需要等到法律强制,AI公司应该主动把决策过程“拆开”给用户看。就像食品包装上要标配料表一样,AI回答也应该标“信息来源表”。

## 技术困境:我们能否反向工程AI的“价值观”?

从技术角度看,“给AI做标注”其实比给食品写配料表难得多。因为大模型的决策不是线性可解释的。即使能输出“参考了哪些文档”,也很难说清楚模型是如何将这些文档组合成最终答案的。这就像让一个厨师解释“为什么这道菜放三克盐而不是两克”——他凭借的是直觉,而不是量化的逻辑。

Brown对此也很坦诚:“人类记者写稿子时,还可以追问他的立场和来源。但AI是一个黑箱,我们连它内部哪一层神经元激活了哪个观点都搞不清楚。”

这引出了一个更尖锐的问题:我们是否应该让AI来回答那些存在事实争议、价值判断的问题?Brown的答案是,有些问题AI根本不该碰。“当AI告诉你‘应该买哪只股票’或者‘哪种政治制度更好’时,无论它怎么回答,都是一种越界。”

## 每个人的数字人格,正在被塑形

在我看来,Brown的忧虑远不止于新闻真实。她其实在探讨一个更深层的命题:当AI成为人类获取信息的最大入口,它实际上在无形中塑造着每一个人的世界观。一个从未接触过某类知识的年轻人,如果AI一直回避那个话题,他可能永远都不会知道还有那样的视角存在。这不是耸人听闻,而是已经在美国青少年通过Character.ai获取性教育内容的案例中得到证实——AI给他们的回答往往比教科书更“安全”,但也更片面。

从商业角度看,这种“信息塑造权”的经济价值无可估量。谁掌握了AI的回答方式,谁就能影响用户的消费决策、政治倾向、甚至下一代的教育方向。这比广告更赚钱,因为它不是在告诉你“买这个”,而是告诉你“这个世界应该是怎样的”。

## 尾声:AI的“新闻伦理”课才刚开始

Campbell Brown的采访其实给整个科技行业上了一堂课:当所有人都痴迷于让AI变“聪明”的时候,我们忽略了让它更“诚实”。这个“诚实”不是说不要撒谎,而是说——让它承认自己有限制,让它展示自己的思考路径,让它告诉用户“我现在给出的答案,是经过我内部一系列不完全透明的处理得到的,请谨慎采信”。

未来的AI竞争,可能不再是比谁回答问题更快更准,而是比谁更敢于向用户承认“我不知道”。毕竟,在信息爆炸却信任崩塌的时代,坦诚本身就是一种稀缺的竞争力。

---

暂无评论